Technical SEO Checkliste: Der komplette Leitfaden (2026)

Die ultimative Technical SEO Checkliste: Crawlability, Indexierung, Seitengeschwindigkeit, Sicherheit, Schema und Mobile. 60+ Aufgaben. Aktualisiert April 2026.

Siddharth Gangal

2026-03-28

Deine Seiten ranken nicht. Du hast starke Inhalte veröffentlicht, Links aufgebaut und die richtigen Keywords gezielt. Aber irgendetwas darunter ist kaputt.

Dieses Etwas ist technisches SEO. Eine einzige falsch konfigurierte robots.txt-Datei kann eine gesamte Website über Nacht deindexieren. Eine Weiterleitungsschleife kann Google daran hindern, deine besten Seiten zu erreichen. Eine Semrush-Studie von 50.000 Domains ergab, dass 52 % defekte Links enthalten, 96 % bei mindestens einer Seite bei den Core Web Vitals scheitern und 70 % Meta-Beschreibungen fehlen.

Diese Technical SEO Checkliste behebt all das. Wir haben 60+ Aufgaben in 9 Kategorien gegliedert, die du Abschnitt für Abschnitt durcharbeiten kannst.

Wir veröffentlichen monatlich 3.500+ Blog-Beiträge in 70+ Branchen. Jede Website, die wir anfassen, durchläuft diese genaue Checkliste, bevor Inhalte live gehen.

Das lernst du hier:

- Wie du Crawlability-Probleme, die Google blockieren, auditierst und behebst

- Wie du Indexierungsprobleme bereinigst, die dein Crawl-Budget verschwenden

- Wie du Core Web Vitals auf jeder Seite bestehst

- Wie du deine Website mit HTTPS und Sicherheits-Headern absicherst

- Wie du Schema Markup implementierst, das Rich Results erzeugt

- Wie du die Mobile-Optimierung für Googles Mobile-First-Index überprüfst

- Wie du KI-Crawler für KI-Suchsichtbarkeit verwaltest

- Wie du ein kontinuierliches Monitoring einrichtest, damit nichts unbemerkt bricht

Warum du eine Technical SEO Checkliste brauchst

Großartige Inhalte können auf einer kaputten Website nicht ranken. Googles eigene Dokumentation besagt, dass eine Seite Mindestanforderungen erfüllen muss, bevor sie überhaupt für die Indexierung in Frage kommt.

Diese Anforderungen klingen einfach. Googlebot darf nicht blockiert sein. Die Seite muss einen 200-Statuscode zurückgeben. Die Seite muss indexierbaren Inhalt enthalten.

Aber die Lücke zwischen „einfach” und „richtig erledigt” ist der Punkt, an dem die meisten Websites scheitern.

Die wahren Kosten technischer Schulden

Semrush-Daten von 50.000 Domains erzählen die Geschichte:

| Problem | % der betroffenen Websites |

|---|---|

| Defekte interne oder externe Links | 52 % |

| Fehlgeschlagene Core Web Vitals (1+ Seite) | 96 % |

| Fehlende Meta-Beschreibungen | 70 % |

| Orphan Pages (keine internen Links) | 69 % |

| Interne doppelte Inhalte | 41 % |

| HTTP/HTTPS Doppelversionen live | 27 % |

| Weiterleitungsketten oder -schleifen | 12 % |

Jedes dieser Probleme reduziert deine organische Sichtbarkeit. Zusammen schaffen sie eine Decke, durch die kein Content durchbrechen kann.

Wann du diese Checkliste ausführen solltest

Führe ein vollständiges SEO-Audit mindestens einmal pro Quartal durch. Monatlich ist besser für Websites mit 500+ Seiten oder häufigen Inhaltsaktualisierungen.

Führe es sofort durch nach:

- Einer Website-Migration oder einem Redesign

- Einem CMS-Update oder Plattformwechsel

- Einem plötzlichen Rückgang des organischen Traffics

- Dem Start einer neuen Subdomain oder eines Unterordners

- Dem Hinzufügen von 50+ Seiten auf einmal (wie bei programmatischem SEO)

Verwende ein kostenloses SEO-Audit-Tool, um die kritischsten Probleme schnell zu erkennen. Arbeite dann diese Checkliste Abschnitt für Abschnitt durch.

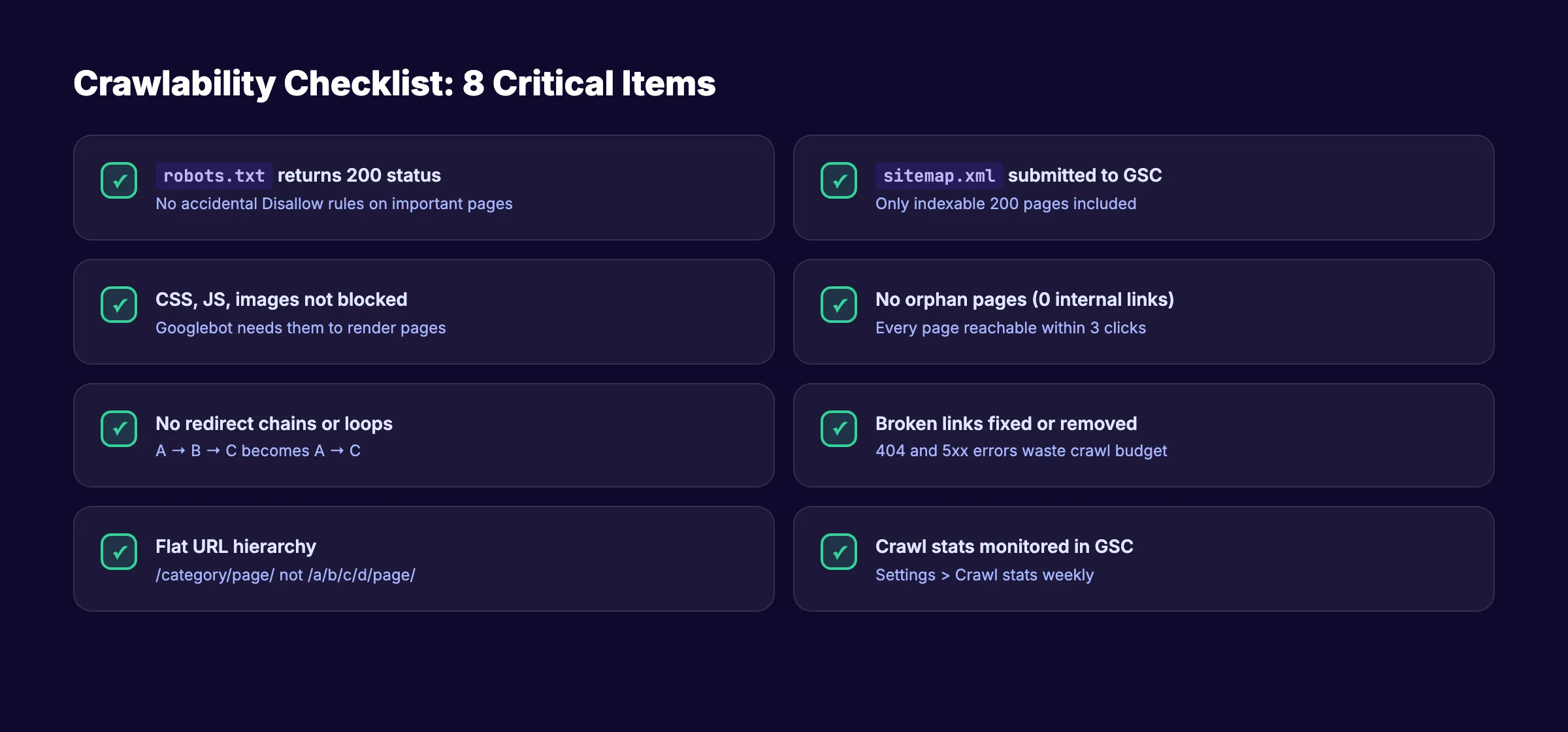

Crawlability-Checkliste

Crawling ist der erste Schritt. Wenn Google eine Seite nicht erreichen kann, existiert diese Seite in den Suchergebnissen nicht. Punkt.

Crawlability-Probleme sind die schädlichsten und die lautlosesten. Deine Website sieht im Browser gut aus. Aber Googlebot sieht etwas völlig anderes.

robots.txt-Konfiguration

Deine robots.txt-Datei teilt Suchmaschinen mit, auf welche URLs sie zugreifen können und auf welche nicht. Eine falsche Zeile blockiert deine gesamte Website.

- Überprüfe, ob

robots.txtunterdeinedomain.com/robots.txtlädt und einen 200-Status zurückgibt - Bestätige, dass keine

Disallow: /-Regeln wichtige Bereiche blockieren - Prüfe, ob CSS-, JS- und Bilddateien nicht blockiert sind (Googlebot braucht sie zum Rendern)

- Entferne übriggebliebene Staging- oder Entwicklungs-

Disallow-Regeln - Referenziere deine XML-Sitemap in

robots.txtmitSitemap: https://deinedomain.com/sitemap.xml - Teste deine Datei mit dem robots.txt-Tester in der Google Search Console

Lies die vollständige Anleitung in unserem robots.txt-Optimierungsleitfaden.

XML-Sitemap

Deine XML-Sitemap ist ein Wegweiser für Suchmaschinen. Eine saubere Sitemap beschleunigt die Entdeckung neuer und aktualisierter Seiten.

- Bestätige, dass deine

sitemap.xmlunterdeinedomain.com/sitemap.xmlerreichbar ist - Füge nur indexierbare Seiten ein (200-Status, kein

noindex, selbstreferenzierendes Canonical) - Entferne 404-, 301- und

noindex-Seiten aus der Sitemap - Halte jede Sitemap-Datei unter 50.000 URLs und 50 MB unkomprimiert

- Verwende eine Sitemap-Index-Datei, wenn du mehrere Sitemaps benötigst

- Reiche deine Sitemap in der Google Search Console unter „Sitemaps” ein

- Überprüfe, ob

<lastmod>-Daten tatsächliche Inhaltsänderungen widerspiegeln (keine automatisierten Zeitstempel)

Sieh unseren schrittweisen XML-Sitemap-Erstellungsleitfaden für Details.

Website-Architektur und Crawl-Tiefe

Jede wichtige Seite sollte innerhalb von 3 Klicks von deiner Homepage erreichbar sein. Tiefer vergrabene Seiten werden seltener gecrawlt und ranken schlechter.

- Kartografiere deine Website-Struktur und bestätige, dass keine wichtige Seite mehr als 3 Klicks tief ist

- Verwende eine flache URL-Hierarchie (

/kategorie/seite/nicht/a/b/c/d/seite/) - Implementiere Breadcrumb-Navigation auf allen inneren Seiten

- Baue logische interne Verlinkungen zwischen verwandten Seiten auf

- Behebe Orphan Pages (Seiten ohne interne Links, die auf sie zeigen)

Crawl-Budget-Management

Crawl-Budget ist am wichtigsten für große Websites (10.000+ Seiten). Aber auch kleinere Websites verschwenden Budget für wertlose URLs.

- Blockiere wertarme URLs vom Crawling (gefilterte Suchergebnisse, Session-IDs, Druckseiten)

- Behebe oder entferne defekte Links, die 404- oder 5xx-Fehler zurückgeben

- Eliminiere Weiterleitungsketten (2+ Weiterleitungen in Folge)

- Reduziere parameter-basierte Duplikat-URLs mit

rel="canonical"oder URL-Parameter-Handling - Überwache Crawl-Statistiken in der Google Search Console unter „Einstellungen” > „Crawl-Statistiken”

Dein technisches SEO-Fundament bestimmt deine Ranking-Obergrenze. Wir auditieren und optimieren jede Website, die wir veröffentlichen. Jetzt starten für 1 $ →

Indexierbarkeits-Checkliste

Indexierung bestimmt, ob Google eine Seite nach dem Crawling in den Suchergebnissen behält.

Eine Seite kann gecrawlt, aber nie indexiert werden. Google bewertet Qualität, Relevanz und Canonical-Signale, bevor es eine Seite in seinen Index aufnimmt.

Index-Abdeckung

- Prüfe den „Seiten”-Bericht in der Google Search Console auf Indexierungsfehler

- Behebe alle „Erkannt. Derzeit nicht indexiert”-Seiten (normalerweise Qualitäts- oder Crawl-Signale)

- Behebe alle „Gecrawlt. Derzeit nicht indexiert”-Seiten (normalerweise dünner Inhalt oder Duplikat-Probleme)

- Behebe „Seite mit Weiterleitung”-Fehler, indem du interne Links auf finale URLs aktualisierst

- Entferne Soft-404-Seiten (sie verschwenden Crawl-Budget, während sie Nutzern leeren Inhalt zeigen)

Canonical-Tags

Das rel="canonical"-Tag teilt Google mit, welche Version einer Seite die primäre ist. Falsche Canonicals verursachen Indexierungs-Chaos.

- Überprüfe, ob jede Seite einen selbstreferenzierenden

<link rel="canonical" href="...">Tag hat - Bestätige, dass Canonical-URLs genau dasselbe Protokoll (

https://), dieselbe Domain und dasselbe Trailing-Slash-Format verwenden - Prüfe, ob paginierte Seiten nicht auf Seite 1 canonical zeigen (sofern das nicht beabsichtigt ist)

- Stelle sicher, dass keine Seite auf eine

noindex-Seite canonical zeigt (widersprüchliche Signale) - Auditiere Canonical-Tags bei URL-Varianten (www vs. nicht-www, HTTP vs. HTTPS, Trailing Slash vs. kein Slash)

Meta-Robots und Noindex-Tags

Ein einzelner falsch platzierter <meta name="robots" content="noindex">-Tag kann eine Seite vollständig aus Google entfernen. Dies ist die häufigste technische SEO-Katastrophe bei Website-Launches.

- Auditiere alle Seiten auf unbeabsichtigte

noindex-Tags - Prüfe HTTP-Antwort-Header auf

X-Robots-Tag: noindex(im Seitenquelltext verborgen) - Verifiziere, dass Staging-Umgebungen andere Domains oder Passwortschutz statt

noindexverwenden - Bestätige, dass dünne oder duplizierte Seiten, die du ausschließen möchtest, tatsächlich

noindexhaben - Überprüfe nach jeder Bereitstellung, dass Produktionsseiten indexierbar bleiben

Doppelter Inhalt

Doppelter Inhalt verwässert Ranking-Signale und verschwendet Crawl-Budget. 41 % der Websites haben interne Probleme mit doppeltem Inhalt.

- Identifiziere exakte und nahezu doppelte Seiten mit Screaming Frog oder Sitebulb

- Konsolidiere Duplikate mit 301-Weiterleitungen oder Canonical-Tags

- Füge

noindexzu gefilterten, sortierten oder paginierten Archivseiten hinzu, die Duplikate erstellen - Prüfe auf HTTP/HTTPS- und www/nicht-www-Doppelversionen deiner gesamten Website

- Behandle URL-Parameter-Duplikate mit Canonical-Tags oder Google Search Console-Parametereinstellungen

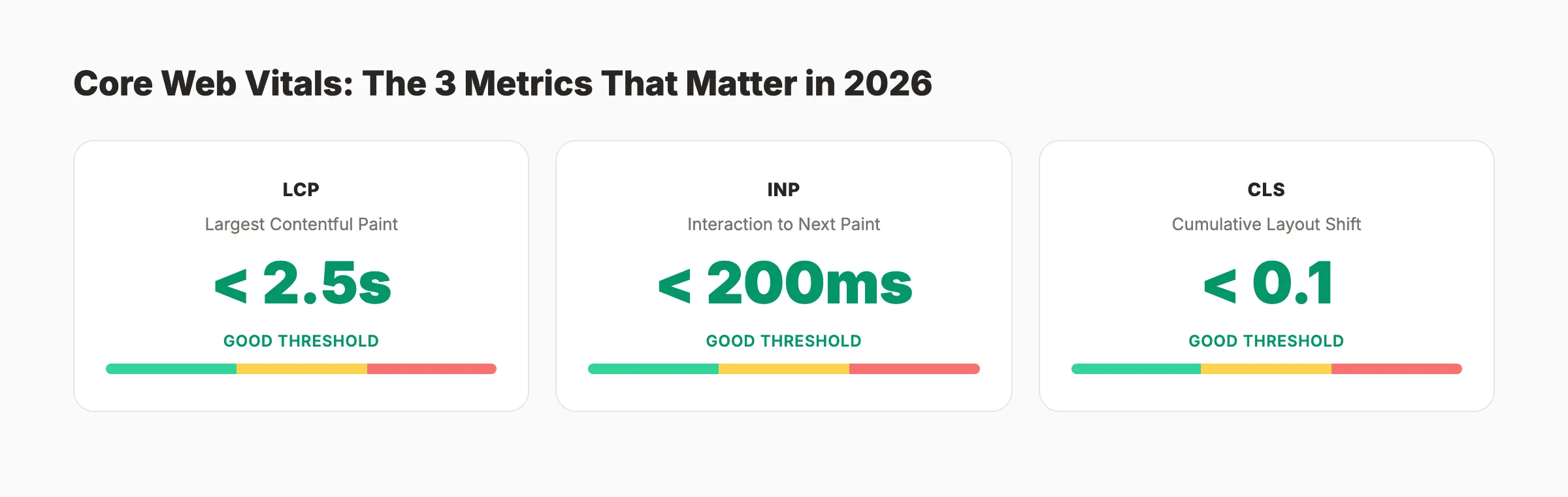

Website-Geschwindigkeit und Core Web Vitals Checkliste

Google verwendet Core Web Vitals als Rankingfaktor. Weniger als 33 % der Websites bestehen die Bewertung. Das bedeutet, das Bestehen gibt dir einen sofortigen Vorteil gegenüber 67 % der konkurrierenden Seiten.

Die 3 Core Web Vitals-Metriken für 2026:

| Metrik | Was es misst | Guter Schwellenwert |

|---|---|---|

| Largest Contentful Paint (LCP) | Ladegeschwindigkeit des größten sichtbaren Elements | Unter 2,5 Sekunden |

| Interaction to Next Paint (INP) | Reaktionsfähigkeit auf Nutzereingaben | Unter 200 Millisekunden |

| Cumulative Layout Shift (CLS) | Visuelle Stabilität beim Laden | Unter 0,1 |

LCP-Optimierung

- Teste LCP in PageSpeed Insights für Mobile und Desktop

- Optimiere das LCP-Element (normalerweise ein Hero-Bild oder Überschriftentext)

- Lade kritische Ressourcen mit

<link rel="preload">vor - Serviere Bilder im WebP- oder AVIF-Format mit richtiger Größenanpassung

- Verwende ein CDN für statische Assets (Bilder, CSS, JS, Schriften)

- Reduziere die Serverantwortzeit (TTFB) auf unter 800 ms

Lies die vollständige Aufschlüsselung in unserem Core Web Vitals-Verbesserungsleitfaden.

INP-Optimierung

- Minimiere die JavaScript-Ausführungszeit bei interaktiven Elementen

- Teile lange Aufgaben (50 ms+) in kleinere asynchrone Teile auf

- Verschiebe nicht-kritische Drittanbieter-Skripte (Analytics, Chat-Widgets, Ad-Tags)

- Verwende

requestAnimationFrameoderrequestIdleCallbackfür nicht-wesentliche Arbeit - Teste INP in Chrome DevTools Performance-Panel unter „Interactions”

CLS-Optimierung

- Setze explizite

width- undheight-Attribute auf alle Bilder und Videos - Reserviere Platz für Anzeigen-Slots und Einbettungen mit Containern fester Abmessungen

- Vermeide das Einfügen von Inhalt über bestehenden sichtbaren Inhalt nach dem Laden der Seite

- Verwende

font-display: swapoderfont-display: optionalfür das Laden von Web-Schriften - Teste CLS nach jeder Layout-Änderung mit Lighthouse oder der Web Vitals-Erweiterung

Allgemeine Leistung

- Aktiviere Gzip- oder Brotli-Komprimierung auf deinem Server

- Minifiziere HTML-, CSS- und JavaScript-Dateien

- Implementiere Browser-Caching mit korrekten

Cache-Control-Headern - Lade Bilder und Videos unterhalb der Falz verzögert (Lazy Loading)

- Eliminiere render-blockierendes CSS und JS im

<head>-Element - Optimiere Blog-Bilder vor dem Hochladen (komprimiere auf unter 200 KB pro Bild)

Websites, die Core Web Vitals bestehen, ranken standardmäßig besser als 67 % der Konkurrenz. Wir bauen jede Seite, die wir veröffentlichen, auf Geschwindigkeit. Jetzt starten für 1 $ →

Mobile-Optimierungs-Checkliste

Google verwendet Mobile-First-Indexierung. Deine mobile Website IST deine Website in Googles Augen. Mobile Geräte machen über 60 % des organischen Suchtraffics aus.

Mobile Darstellung

- Teste jede Seitenvorlage mit Googles Mobile-Friendly-Test

- Überprüfe deinen Viewport-Meta-Tag:

<meta name="viewport" content="width=device-width, initial-scale=1"> - Bestätige, dass Text ohne Zoomen lesbar ist (mindestens 16 px Schriftgröße für Fließtext)

- Stelle sicher, dass Tipp-Ziele (Buttons, Links) mindestens 48×48 Pixel mit 8 px Abstand sind

- Prüfe, ob kein Inhalt breiter als der Bildschirm ist (horizontales Scrollen ist ein Fehler)

Inhaltsparität

- Überprüfe, ob mobile Seiten denselben Inhalt wie Desktop-Seiten enthalten

- Bestätige, dass alle strukturierten Daten in der mobilen Version vorhanden sind

- Prüfe, ob Bilder, Videos und Alt-Text auf Mobile erscheinen

- Stelle sicher, dass Heading-Tags und Meta-Beschreibungen über Versionen hinweg identisch sind

- Teste lazy-geladenen Inhalt mit dem Googlebot-Smartphone-User-Agent

Mobile Geschwindigkeit

- Teste mobile Seitengeschwindigkeit separat (mobile Verbindungen sind langsamer)

- Priorisiere LCP-Optimierung speziell für Mobile

- Reduziere das Gesamtseitengewicht auf unter 3 MB auf Mobile

- Vermeide große JavaScript-Bundles, die das mobile Rendering blockieren

- Komprimiere Bilder auf mobile-gerechte Größen mit

srcset- undsizes-Attributen

Sicherheits-Checkliste

HTTPS ist ein bestätigter Google-Rankingfaktor. Über Rankings hinaus kennzeichnen Browser HTTP-Websites als „Nicht sicher”, was das Nutzervertrauen und die Konversionsraten senkt.

HTTPS-Implementierung

- Installiere ein gültiges SSL/TLS-Zertifikat auf allen Domains und Subdomains

- Leite alle HTTP-URLs auf HTTPS mit 301-Weiterleitungen um

- Aktualisiere alle internen Links auf

https://(nicht protokoll-relativ//) - Überprüfe auf Mixed-Content-Warnungen (HTTP-Ressourcen, die auf HTTPS-Seiten geladen werden)

- Setze HSTS-Header:

Strict-Transport-Security: max-age=31536000; includeSubDomains - Bestätige, dass dein SSL-Zertifikat nicht abgelaufen oder falsch konfiguriert ist

Sicherheits-Header

- Füge

Content-Security-Policy-Header hinzu, um XSS-Angriffe zu verhindern - Implementiere

X-Content-Type-Options: nosniff, um MIME-Type-Sniffing zu verhindern - Setze

X-Frame-Options: SAMEORIGIN, um Clickjacking zu verhindern - Füge

Referrer-Policy: strict-origin-when-cross-originzur Kontrolle von Referrer-Daten hinzu - Aktiviere

Permissions-Policy, um Browser-Feature-Zugriff zu kontrollieren

Malware- und Spam-Schutz

- Überwache den „Sicherheitsprobleme”-Bericht der Google Search Console wöchentlich

- Scanne nach eingeschleustem Spam oder Malware mit Sucuri SiteCheck oder ähnlichen Tools

- Halte dein CMS, Plugins und Server-Software auf den neuesten stabilen Versionen aktuell

- Überprüfe nutzergenerierte Inhaltsbereiche (Kommentare, Foren) auf Spam-Links

- Richte Google Safe Browsing-Benachrichtigungen für deine Domain ein

Strukturierte Daten und Schema-Checkliste

Strukturierte Daten helfen Google, die Bedeutung deines Inhalts zu verstehen. Sie erzielen auch Rich Results wie FAQ-Dropdowns, Sternebewertungen, How-To-Schritte und Breadcrumbs in Suchergebnissen.

Googles strukturierte Datendokumentation listet 30+ unterstützte Schema-Typen auf.

Erforderliche Schema-Typen

Nicht jeder Typ gilt für jede Website. Beginne mit diesen basierend auf deinem Inhalt:

| Schema-Typ | Verwendung für | Rich Result |

|---|---|---|

Article | Blog-Beiträge und News-Artikel | Überschrift + Datum in Ergebnissen |

FAQPage | FAQ-Abschnitte innerhalb von Seiten | Erweiterbare Q&A in Ergebnissen |

HowTo | Schritt-für-Schritt-Tutorials | Nummerierte Schritte in Ergebnissen |

LocalBusiness | Physische Unternehmensstandorte | Knowledge Panel, Map Pack |

Organization | Unternehmensinformationen | Logo + Social-Links im Panel |

BreadcrumbList | Website-Navigations-Breadcrumbs | Breadcrumb-Pfad in Ergebnissen |

Product | E-Commerce-Produktseiten | Preis, Verfügbarkeit, Bewertungen |

Implementierungs-Checkliste

- Füge

Organization-Schema auf deiner Homepage mit Name, Logo, URL und Social-Profilen hinzu - Implementiere

Article- oderBlogPosting-Schema auf allen Blog-Inhalten - Füge

FAQPage-Schema zu Seiten mit FAQ-Abschnitten hinzu - Verwende

BreadcrumbList-Schema auf allen inneren Seiten - Füge

LocalBusiness-Schema hinzu, wenn du einen physischen Standort hast - Füge Autor- und Publisher-Markup für E-E-A-T-Signale hinzu

Lies die vollständige Anleitung in unserem Schema-Markup-Leitfaden.

Validierung und Tests

- Teste alle Schemas mit Googles Rich Results Test

- Validiere JSON-LD-Syntax mit dem Schema.org-Validator

- Prüfe den „Verbesserungen”-Abschnitt der Google Search Console auf Schema-Fehler

- Überwache das Erscheinen von Rich Results im Search Console-Performance-Bericht

- Verwende unseren kostenlosen Schema-Markup-Generator, um gültiges JSON-LD schnell zu erstellen

Strukturierte Daten erzielen Rich Results, die die Click-Through-Rate um 20–30 % steigern. Jeder Blog-Beitrag, den wir veröffentlichen, enthält vollständiges Schema-Markup. Jetzt starten für 1 $ →

URL-Struktur und Weiterleitungs-Checkliste

Saubere URLs helfen Nutzern und Suchmaschinen, deinen Inhalt vor dem Klicken zu verstehen. Richtiges Weiterleitungs-Handling bewahrt Link-Equity und verhindert Crawl-Verschwendung.

URL Best Practices

- Verwende Kleinbuchstaben, durch Bindestriche getrennte URLs:

/technical-seo-checkliste/nicht/Technical_SEO_Checkliste - Halte URLs kurz und beschreibend (wenn möglich unter 75 Zeichen)

- Füge dein Ziel-Keyword in den URL-Slug ein

- Vermeide URL-Parameter für Inhaltsseiten (

?id=123erzeugt doppelten Inhalt) - Verwende eine konsistente Trailing-Slash-Konvention auf der gesamten Website (entweder immer oder nie)

- Vermeide datumsbasierte URLs für Evergreen-Inhalte (

/2026/03/beitrag/lässt Inhalte veraltet wirken)

Weiterleitungs-Management

- Auditiere alle Weiterleitungen auf Ketten (A leitet auf B leitet auf C weiter) und behebe sie auf A nach C

- Ersetze 302-Weiterleitungen (temporär) durch 301-Weiterleitungen für permanente Verschiebungen

- Aktualisiere interne Links, um direkt auf finale URLs zu zeigen (verlasse dich nicht auf Weiterleitungen)

- Richte 301-Weiterleitungen für alle gelöschten oder verschobenen Seiten zur nächsten relevanten Seite ein

- Überwache 404-Fehler in der Google Search Console und leite Traffic-starke weiter

- Halte ein Weiterleitungs-Mapping-Dokument aktuell, wenn du URL-Strukturen änderst

404-Seiten-Optimierung

- Erstelle eine benutzerdefinierte 404-Seite mit Navigation, Suche und Links zu beliebten Inhalten

- Gib den korrekten 404-HTTP-Statuscode zurück (keine Soft-404, die 200 zurückgibt)

- Crawle deine Website regelmäßig, um interne Links zu 404-Seiten zu finden und zu reparieren

- Prüfe auf 404-Fehler durch externe Links und leite sie weiter, wenn der Inhalt verschoben wurde

KI-Crawler und LLM-Bereitschafts-Checkliste

Im Jahr 2026 geht Suche über Google hinaus. KI-Antwort-Engines wie ChatGPT Search, Perplexity und Google AI Overviews ziehen Daten von Websites, um Antworten zu generieren. Deine robots.txt regelt jetzt den Zugang für traditionelle und KI-Crawler.

KI-Crawler-Zugang

- Entscheide deine KI-Crawler-Richtlinie: Trainings-Bots erlauben, Retrieval-Bots, beide oder keinen

- Füge explizite Regeln für

GPTBot,ClaudeBot,PerplexityBotundGoogle-Extendedinrobots.txthinzu - Erlaube Retrieval-Bots, wenn du in KI-Suchergebnissen sichtbar sein möchtest

- Blockiere Trainings-Bots, wenn du nicht möchtest, dass dein Inhalt für das Modell-Training verwendet wird

- Überprüfe deine Richtlinie vierteljährlich, da neue KI-Crawler entstehen

Beispiel robots.txt-Regeln:

## Retrieval für KI-Suche erlauben

User-agent: GPTBot

Allow: /blog/

Disallow: /private/

## Training blockieren

User-agent: Google-Extended

Disallow: /Lies unseren vollständigen KI-Crawler-Leitfaden für die vollständige Aufschlüsselung jedes Bots.

LLM-Inhalts-Optimierung

- Erstelle eine

llms.txt-Datei im Stammverzeichnis deiner Domain mit einer strukturierten Zusammenfassung deiner Website (siehe unseren llms.txt-Leitfaden) - Strukturiere Inhalte mit klaren Überschriften, Aufzählungspunkten und direkten Antworten

- Füge entitätsreiche Inhalte mit genannten Tools, Marken und spezifischen Datenpunkten hinzu

- Füge Autorenbiografien und E-E-A-T-Signale hinzu, die KI-Systeme zur Bewertung der Quellenautorität verwenden

- Überwache die KI-Suchsichtbarkeit mit Tools wie Otterly.ai oder manuellen Tests in ChatGPT und Perplexity

Lerne, wie du speziell für Google AI Overviews optimierst.

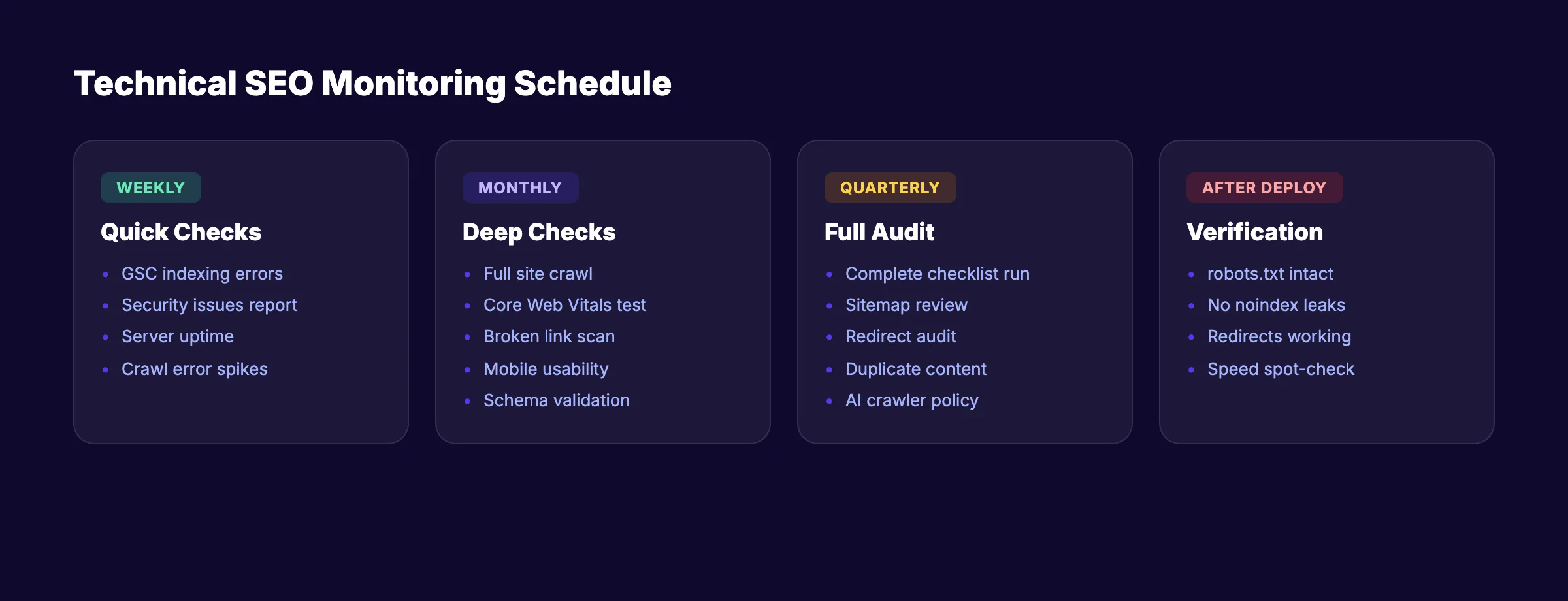

Monitoring und Wartungs-Checkliste

Technisches SEO ist kein einmaliges Projekt. Websites brechen lautlos. CMS-Updates führen Bugs ein. Plugins fügen Bloat hinzu. Entwickler pushen Code, der die Indexierung blockiert.

Baue ein wiederkehrendes Monitoring-System auf, um Probleme zu erkennen, bevor sie Rankings schaden.

Wöchentliche Checks

- Überprüfe den „Seiten”-Bericht der Google Search Console auf neue Indexierungsfehler

- Prüfe den „Sicherheitsprobleme”-Bericht auf Malware- oder Hacking-Warnungen

- Überwache Server-Uptime und Antwortzeit

- Überprüfe Crawl-Fehler-Spitzen in den Search Console-Crawl-Statistiken

Monatliche Checks

- Führe einen vollständigen Website-Crawl mit Screaming Frog, Sitebulb oder unserem kostenlosen Audit-Tool durch

- Teste Core Web Vitals auf deinen 10 Traffic-stärksten Seiten

- Prüfe auf neue defekte Links auf der gesamten Website

- Überprüfe den Mobile-Usability-Bericht in der Google Search Console

- Auditiere Schema-Validierung für alle neuen oder aktualisierten Seiten

- Prüfe deinen Website-SEO-Score für den allgemeinen Zustand

Vierteljährliche Checks

- Führe ein vollständiges Audit mit dieser gesamten Technical SEO Checkliste durch

- Überprüfe und aktualisiere deine XML-Sitemap (entferne tote Seiten, füge neue hinzu)

- Auditiere Weiterleitungsketten und -schleifen

- Prüfe auf neue doppelte Inhaltsprobleme

- Überprüfe KI-Crawler-Richtlinien und aktualisiere

robots.txtnach Bedarf - Analysiere Google Analytics 4-Daten für Seiten mit hohen Impressionen, aber niedrigen Klicks

Nach jeder Bereitstellung

- Überprüfe, ob

robots.txtnicht mit Staging-Regeln überschrieben wurde - Bestätige, dass

noindex-Tags nicht auf Produktionsseiten gepusht wurden - Teste, ob 301-Weiterleitungen noch funktionieren

- Führe einen schnellen Crawl von 50–100 Schlüsselseiten durch, um auf Fehler zu prüfen

- Teste die Seitengeschwindigkeit auf 3–5 wichtigen Vorlagen

Empfohlene Tools

| Tool | Was es tut | Kosten |

|---|---|---|

| Google Search Console | Index-Abdeckung, Crawl-Statistiken, Core Web Vitals | Kostenlos |

| Screaming Frog | Vollständiger Website-Crawl bis 500 URLs | Kostenlos (kostenpflichtig für 500+) |

| PageSpeed Insights | Core Web Vitals-Tests | Kostenlos |

| Ahrefs Site Audit | Vollständiges technisches Audit mit Monitoring | Kostenpflichtig |

| Sitebulb | Visuelle Crawl-Analyse | Kostenpflichtig |

| Stacc SEO Audit Tool | Schnelle Website-Gesundheitsprüfung | Kostenlos |

Verwende die Google Search Console als dein primäres kostenloses Monitoring-Tool. Es erkennt die meisten kritischen technischen Probleme und sendet E-Mail-Benachrichtigungen bei schwerwiegenden Problemen.

Wenn du die manuelle Arbeit völlig überspringen möchtest, automatisiere deinen SEO-Workflow und lass ein System das Monitoring für dich übernehmen.

Technisches SEO-Wartung ist der Unterschied zwischen Ranken und Nicht-Ranken. Wir kümmern uns um das technische Fundament für jede Website, die wir veröffentlichen. Jetzt starten für 1 $ →

FAQ

Was ist eine Technical SEO Checkliste?

Eine Technical SEO Checkliste ist eine strukturierte Liste von Aufgaben, die sicherstellen, dass Suchmaschinen deine Website korrekt crawlen, indexieren, rendern und ranken können. Sie umfasst Server-Konfiguration, Seitengeschwindigkeit, Sicherheit, strukturierte Daten, Mobile-Optimierung und URL-Management. Denke daran als Fundamentprüfung, bevor du etwas darauf baust.

Wie oft sollte ich ein technisches SEO-Audit durchführen?

Führe mindestens einmal pro Quartal ein vollständiges Audit durch. Große Websites (10.000+ Seiten) oder Websites mit häufigen Updates sollten monatlich auditieren. Führe die Checkliste immer nach einem Website-Redesign, einer CMS-Migration oder einem Plattform-Update durch. Lies Wie man ein SEO-Audit durchführt für den vollständigen Prozess.

Was sind die kritischsten technischen SEO-Probleme, die zuerst behoben werden sollten?

Beginne mit Indexierungsblockern. Prüfe auf versehentliche noindex-Tags, robots.txt-Blockierungen und Canonical-Fehler. Diese verhindern, dass Google deine Seiten überhaupt sieht. Als nächstes behebe defekte Links und Weiterleitungsketten. Dann kümmere dich um Core Web Vitals und Seitengeschwindigkeit. Du kannst beste kostenlose SEO-Tools verwenden, um die größten Probleme schnell zu identifizieren.

Beeinflusst technisches SEO Rankings direkt?

Ja. Google bestätigt, dass HTTPS, Core Web Vitals und Mobile-Freundlichkeit Rankingfaktoren sind. Crawlability und Indexierung sind vollständige Voraussetzungen für Rankings. Eine Seite, die Google nicht crawlen oder indexieren kann, hat null Chance, in Suchergebnissen zu erscheinen. Websites, die technische Probleme beheben, sehen typischerweise Ranking-Verbesserungen innerhalb von 60 bis 90 Tagen.

Kann ich technisches SEO selbst ohne einen Entwickler machen?

Viele Punkte auf dieser Checkliste erfordern grundlegende technische Kenntnisse, aber keine vollständigen Entwicklerfähigkeiten. Du kannst deine Website mit kostenlosen Tools wie Google Search Console und Screaming Frog auditieren. Für Änderungen an der Server-Konfiguration, .htaccess-Dateien oder Antwort-Headern benötigst du möglicherweise einen Entwickler. Wenn du SEO für deine neue Website ohne ein Team erledigt haben möchtest, eliminieren Done-for-You-Services die Lernkurve.

Wie verhält sich technisches SEO zu On-Page SEO?

Technisches SEO stellt sicher, dass Google auf deine Website zugreifen und sie verstehen kann. On-Page SEO optimiert einzelne Seiteninhalte für Ziel-Keywords. Beides ist erforderlich. Technisches SEO ist das Fundament. On-Page SEO ist die darauf gebaute Struktur. Keines funktioniert vollständig ohne das andere.

Fange an, deine Checkliste durchzuarbeiten

Jede Ranking-Verbesserung beginnt mit dem richtigen technischen Fundament. Drucke diese Checkliste aus. Öffne die Google Search Console. Arbeite einen Abschnitt pro Tag durch.

Wenn du lieber die manuelle Arbeit überspringen möchtest, kümmern wir uns um die gesamte technische und inhaltliche Seite von SEO für kleine Unternehmen und Dienstleistungsunternehmen in 70+ Branchen. Deine ersten 3 Tage kosten 1 $.

Häufig gestellte Fragen

Eine Technical SEO Checkliste ist eine strukturierte Liste von Aufgaben, die sicherstellen, dass Suchmaschinen deine Website korrekt crawlen, indexieren, rendern und ranken können. Sie umfasst Server-Konfiguration, Seitengeschwindigkeit, Sicherheit, strukturierte Daten, Mobile-Optimierung und URL-Management. Denke daran als Fundamentprüfung, bevor du etwas darauf baust.

Führe mindestens einmal pro Quartal ein vollständiges Audit durch. Große Websites (10.000+ Seiten) oder Websites mit häufigen Updates sollten monatlich auditieren. Führe die Checkliste immer nach einem Website-Redesign, einer CMS-Migration oder einem Plattform-Update durch. Lies Wie man ein SEO-Audit durchführt für den vollständigen Prozess.

Beginne mit Indexierungsblockern. Prüfe auf versehentliche noindex-Tags, robots.txt-Blockierungen und Canonical-Fehler. Diese verhindern, dass Google deine Seiten überhaupt sieht. Als nächstes behebe defekte Links und Weiterleitungsketten. Dann kümmere dich um Core Web Vitals und Seitengeschwindigkeit. Du kannst beste kostenlose SEO-Tools verwenden, um die größten Probleme schnell zu identifizieren.

Ja. Google bestätigt, dass HTTPS, Core Web Vitals und Mobile-Freundlichkeit Rankingfaktoren sind. Crawlability und Indexierung sind vollständige Voraussetzungen für Rankings. Eine Seite, die Google nicht crawlen oder indexieren kann, hat null Chance, in Suchergebnissen zu erscheinen. Websites, die technische Probleme beheben, sehen typischerweise Ranking-Verbesserungen innerhalb von 60 bis 90 Tagen.

Viele Punkte auf dieser Checkliste erfordern grundlegende technische Kenntnisse, aber keine vollständigen Entwicklerfähigkeiten. Du kannst deine Website mit kostenlosen Tools wie Google Search Console und Screaming Frog auditieren. Für Änderungen an der Server-Konfiguration, .htaccess-Dateien oder Antwort-Headern benötigst du möglicherweise einen Entwickler. Wenn du SEO für deine neue Website ohne ein Team erledigt haben möchtest, eliminieren Done-for-You-Services die Lernkurve.

Technisches SEO stellt sicher, dass Google auf deine Website zugreifen und sie verstehen kann. On-Page SEO optimiert einzelne Seiteninhalte für Ziel-Keywords. Beides ist erforderlich. Technisches SEO ist das Fundament. On-Page SEO ist die darauf gebaute Struktur. Keines funktioniert vollständig ohne das andere.