Checklist SEO Technique : Le Guide Complet (2026)

Checklist SEO technique complète : exploration, indexation, vitesse, sécurité, schema et mobile. Plus de 60 actions à mettre en œuvre. Mis à jour avril 2026.

Vos pages ne se positionnent pas. Vous avez publié du contenu solide, obtenu des liens et ciblé les bons mots-clés. Mais quelque chose en dessous est cassé.

Ce quelque chose, c’est le SEO technique. Un seul fichier robots.txt mal configuré peut désindexer un site entier du jour au lendemain. Une boucle de redirections peut empêcher Google d’atteindre vos meilleures pages. Une étude Semrush portant sur 50 000 domaines a révélé que 52 % contiennent des liens brisés, 96 % échouent aux Core Web Vitals sur au moins 1 page, et 70 % n’ont pas de méta descriptions.

Cette checklist SEO technique corrige tout cela. Nous avons organisé plus de 60 actions en 9 catégories que vous pouvez parcourir section par section.

Nous publions plus de 3 500 articles de blog dans plus de 70 secteurs chaque mois. Chaque site que nous touchons passe par cette checklist exacte avant que le contenu ne soit mis en ligne.

Voici ce que vous apprendrez :

- Comment auditer et corriger les problèmes d’exploration qui bloquent Google

- Comment nettoyer les problèmes d’indexation qui gaspillent votre budget d’exploration

- Comment réussir les Core Web Vitals sur chaque page

- Comment sécuriser votre site avec HTTPS et des en-têtes de sécurité

- Comment implémenter le balisage schema qui génère des résultats enrichis

- Comment vérifier l’optimisation mobile pour l’index mobile-first de Google

- Comment gérer les robots d’exploration IA pour la visibilité dans les recherches IA

- Comment mettre en place une surveillance continue pour que rien ne se casse silencieusement

Pourquoi vous avez besoin d’une checklist SEO technique

Un excellent contenu ne peut pas se positionner sur un site web défaillant. La propre documentation de Google indique qu’une page doit satisfaire des exigences techniques minimales avant d’être éligible à l’indexation.

Ces exigences semblent simples. Googlebot ne doit pas être bloqué. La page doit renvoyer un code de statut 200. La page doit contenir du contenu indexable.

Mais l’écart entre « simple » et « fait correctement » est là où la plupart des sites échouent.

Le vrai coût de la dette technique

Les données Semrush de 50 000 domaines racontent l’histoire :

| Problème | % des sites affectés |

|---|---|

| Liens internes ou externes brisés | 52 % |

| Core Web Vitals échoués (1+ page) | 96 % |

| Méta descriptions manquantes | 70 % |

| Pages orphelines (aucun lien interne) | 69 % |

| Contenu dupliqué interne | 41 % |

| Versions HTTP/HTTPS doubles actives | 27 % |

| Chaînes ou boucles de redirections | 12 % |

Chacun de ces problèmes réduit votre visibilité organique. Cumulés, ils créent un plafond qu’aucun contenu ne peut briser.

Quand exécuter cette checklist

Effectuez un audit SEO complet au minimum une fois par trimestre. Mensuellement est préférable pour les sites de 500+ pages ou avec des mises à jour fréquentes.

Exécutez-la immédiatement après :

- Une migration ou refonte de site

- Une mise à jour du CMS ou un changement de plateforme

- Une chute soudaine du trafic organique

- Le lancement d’un nouveau sous-domaine ou sous-dossier

- L’ajout de 50+ pages à la fois (comme avec le SEO programmatique)

Utilisez un outil d’audit SEO gratuit pour détecter rapidement les problèmes les plus critiques. Ensuite, parcourez cette checklist section par section.

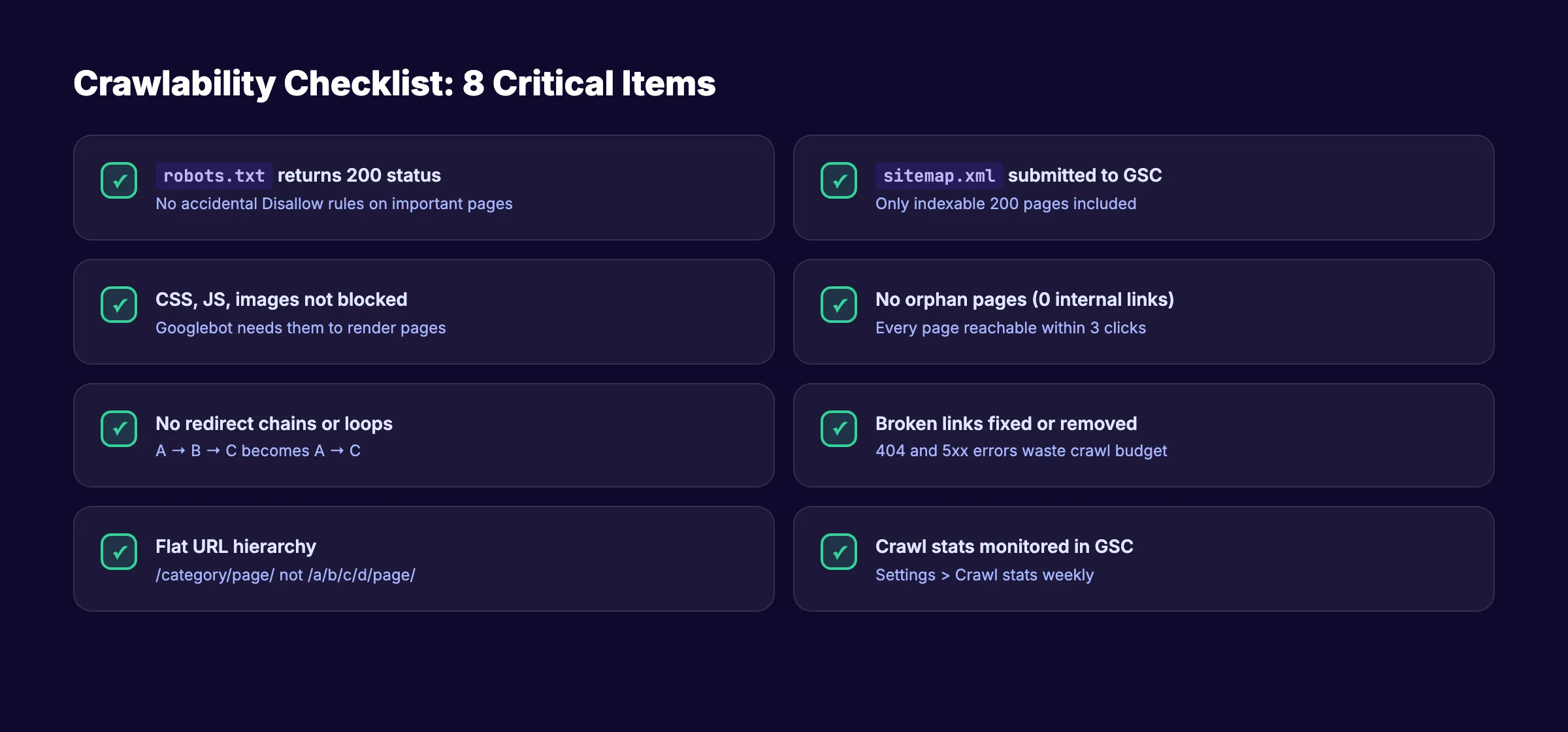

Checklist d’exploration (crawlabilité)

L’exploration est l’étape zéro. Si Google ne peut pas atteindre une page, cette page n’existe pas dans les résultats de recherche. Point final.

Les problèmes de crawlabilité sont les plus dommageables et les plus silencieux. Votre site semble bien dans un navigateur. Mais Googlebot voit quelque chose de complètement différent.

Configuration de robots.txt

Votre fichier robots.txt indique aux moteurs de recherche quelles URL ils peuvent et ne peuvent pas accéder. Une seule ligne incorrecte bloque tout votre site.

- Vérifiez que

robots.txtse charge àvotredomaine.com/robots.txtet renvoie un statut 200 - Confirmez qu’aucune règle

Disallow: /ne bloque des sections importantes - Vérifiez que les fichiers CSS, JS et images ne sont pas bloqués (Googlebot en a besoin pour rendre les pages)

- Supprimez les règles

Disallowde staging ou de développement restantes - Référencez votre sitemap XML dans

robots.txtavecSitemap: https://votredomaine.com/sitemap.xml - Testez votre fichier avec le testeur robots.txt de la Google Search Console

Lisez le guide complet dans notre article d’optimisation robots.txt.

Sitemap XML

Votre sitemap XML est une feuille de route pour les moteurs de recherche. Un sitemap propre accélère la découverte des pages nouvelles et mises à jour.

- Confirmez que votre

sitemap.xmlest accessible àvotredomaine.com/sitemap.xml - Incluez uniquement les pages indexables (statut 200, pas de

noindex, canonical auto-référençant) - Supprimez du sitemap les pages 404, 301 et

noindex - Gardez chaque fichier sitemap sous 50 000 URLs et 50 Mo non compressés

- Utilisez un fichier d’index de sitemap si vous avez besoin de plusieurs sitemaps

- Soumettez votre sitemap dans Google Search Console sous « Sitemaps »

- Vérifiez que les dates

<lastmod>reflètent les changements de contenu réels (pas des horodatages automatisés)

Consultez notre guide étape par étape de création de sitemap XML pour plus de détails.

Architecture du site et profondeur d’exploration

Chaque page importante doit être accessible en 3 clics depuis votre page d’accueil. Les pages plus enfouies sont explorées moins souvent et se positionnent moins bien.

- Cartographiez la structure de votre site et confirmez qu’aucune page importante n’est à plus de 3 clics de profondeur

- Utilisez une hiérarchie d’URL plate (

/categorie/page/et non/a/b/c/d/page/) - Implémentez une navigation en fil d’Ariane sur toutes les pages internes

- Construisez des liens internes logiques entre les pages connexes

- Corrigez les pages orphelines (pages sans liens internes pointant vers elles)

Gestion du budget d’exploration

Le budget d’exploration est surtout important pour les grands sites (10 000+ pages). Mais même les petits sites gaspillent du budget sur des URLs sans valeur.

- Bloquez l’exploration des URLs à faible valeur (résultats de recherche filtrés, ID de session, pages d’impression)

- Corrigez ou supprimez les liens brisés qui renvoient des erreurs 404 ou 5xx

- Éliminez les chaînes de redirections (2+ redirections en séquence)

- Réduisez les URLs en double basées sur des paramètres avec

rel="canonical"ou la gestion des paramètres d’URL - Surveillez les statistiques d’exploration dans Google Search Console sous « Paramètres » > « Statistiques d’exploration »

Votre fondation SEO technique détermine votre plafond de positionnement. Nous auditons et optimisons chaque site que nous publions. Commencer pour 1 $ →

Checklist d’indexabilité

L’indexation détermine si Google conserve une page dans les résultats de recherche après l’avoir explorée.

Une page peut être explorée mais jamais indexée. Google évalue la qualité, la pertinence et les signaux canoniques avant d’ajouter une page à son index.

Couverture de l’index

- Vérifiez le rapport « Pages » dans Google Search Console pour les erreurs d’indexation

- Corrigez toutes les pages « Découvertes. Actuellement non indexées » (généralement des signaux de qualité ou d’exploration)

- Corrigez toutes les pages « Explorées. Actuellement non indexées » (généralement du contenu mince ou des problèmes de doublons)

- Résolvez les erreurs « Page avec redirection » en mettant à jour les liens internes pour pointer vers les URLs finales

- Supprimez les pages soft 404 (elles gaspillent le budget d’exploration tout en montrant du contenu vide aux utilisateurs)

Balises canonical

La balise rel="canonical" indique à Google quelle version d’une page est la principale. Des canonicals incorrects provoquent le chaos d’indexation.

- Vérifiez que chaque page a une balise

<link rel="canonical" href="...">auto-référençante - Confirmez que les URLs canoniques utilisent exactement le même protocole (

https://), domaine et format de barre oblique finale - Vérifiez que les pages paginées ne pointent pas canoniquement vers la page 1 (sauf si c’est intentionnel)

- Assurez-vous qu’aucune page ne pointe canoniquement vers une page

noindex(signaux contradictoires) - Auditez les balises canonical sur les variantes d’URL (www vs. sans www, HTTP vs. HTTPS, avec ou sans barre oblique finale)

Meta robots et balises noindex

Une seule balise <meta name="robots" content="noindex"> mal placée peut supprimer une page de Google entièrement. C’est la catastrophe SEO technique la plus courante lors des lancements de sites.

- Auditez toutes les pages pour les balises

noindexnon intentionnelles - Vérifiez les en-têtes de réponse HTTP pour

X-Robots-Tag: noindex(caché dans le code source de la page) - Vérifiez que les environnements de staging utilisent des domaines différents ou une protection par mot de passe plutôt que

noindex - Confirmez que les pages minces ou dupliquées que vous souhaitez exclure ont bien

noindexappliqué - Vérifiez après chaque déploiement que les pages de production restent indexables

Contenu dupliqué

Le contenu dupliqué dilue les signaux de positionnement et gaspille le budget d’exploration. 41 % des sites ont des problèmes internes de contenu dupliqué.

- Identifiez les pages exactes et quasi-dupliquées avec Screaming Frog ou Sitebulb

- Consolidez les doublons avec des redirections 301 ou des balises canonical

- Ajoutez

noindexaux pages d’archive filtrées, triées ou paginées qui créent des doublons - Vérifiez s’il existe des versions doubles HTTP/HTTPS et www/sans www de tout votre site

- Gérez les doublons de paramètres d’URL avec des balises canonical ou les paramètres de Google Search Console

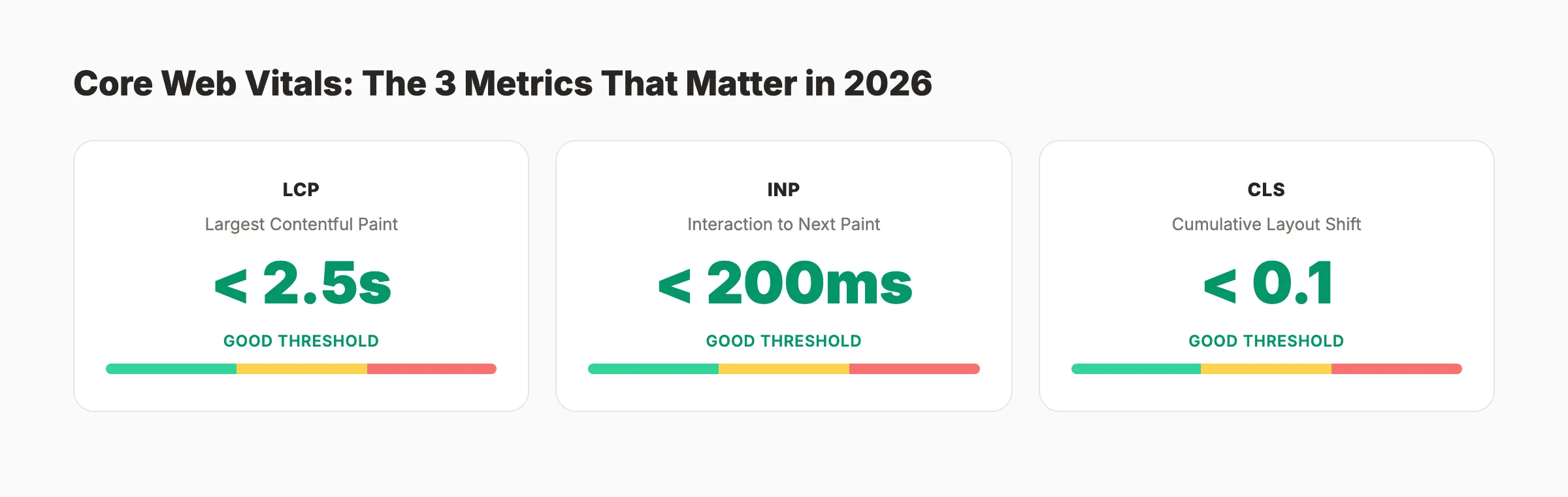

Checklist de vitesse du site et Core Web Vitals

Google utilise les Core Web Vitals comme facteur de positionnement. Moins de 33 % des sites web réussissent l’évaluation. Cela signifie que réussir vous donne un avantage immédiat sur 67 % des pages concurrentes.

Les 3 métriques Core Web Vitals pour 2026 :

| Métrique | Ce qu’elle mesure | Bon seuil |

|---|---|---|

| Largest Contentful Paint (LCP) | Vitesse de chargement du plus grand élément visible | Moins de 2,5 secondes |

| Interaction to Next Paint (INP) | Réactivité aux entrées utilisateur | Moins de 200 millisecondes |

| Cumulative Layout Shift (CLS) | Stabilité visuelle pendant le chargement | Moins de 0,1 |

Optimisation du LCP

- Testez le LCP dans PageSpeed Insights pour mobile et bureau

- Optimisez l’élément LCP (généralement une image hero ou un texte de titre)

- Préchargez les ressources critiques avec

<link rel="preload"> - Servez les images en format WebP ou AVIF avec un dimensionnement approprié

- Utilisez un CDN pour les actifs statiques (images, CSS, JS, polices)

- Réduisez le temps de réponse du serveur (TTFB) à moins de 800 ms

Lisez l’analyse complète dans notre guide d’amélioration des Core Web Vitals.

Optimisation de l’INP

- Minimisez le temps d’exécution JavaScript sur les éléments interactifs

- Divisez les longues tâches (50 ms+) en petits morceaux asynchrones

- Différez les scripts tiers non critiques (analytics, widgets de chat, balises publicitaires)

- Utilisez

requestAnimationFrameourequestIdleCallbackpour le travail non essentiel - Testez l’INP dans le panneau Performance de Chrome DevTools sous « Interactions »

Optimisation du CLS

- Définissez des attributs explicites

widthetheightsur toutes les images et vidéos - Réservez de l’espace pour les emplacements publicitaires et les intégrations avec des conteneurs de dimensions fixes

- Évitez d’injecter du contenu au-dessus du contenu visible existant après le chargement de la page

- Utilisez

font-display: swapoufont-display: optionalpour gérer le chargement des polices web - Testez le CLS après chaque modification de mise en page avec Lighthouse ou l’extension Web Vitals

Performance générale

- Activez la compression Gzip ou Brotli sur votre serveur

- Minifiez les fichiers HTML, CSS et JavaScript

- Implémentez la mise en cache du navigateur avec les bons en-têtes

Cache-Control - Chargez paresseusement (lazy load) les images et vidéos sous le pli

- Éliminez le CSS et JS bloquant le rendu dans le

<head>du document - Optimisez les images de blog avant de les télécharger (compressez à moins de 200 Ko par image)

Les sites qui réussissent les Core Web Vitals surpassent par défaut 67 % de la concurrence. Nous construisons chaque page que nous publions pour la performance. Commencer pour 1 $ →

Checklist d’optimisation mobile

Google utilise l’indexation mobile-first. Votre site mobile EST votre site aux yeux de Google. Les appareils mobiles représentent plus de 60 % du trafic de recherche organique.

Rendu mobile

- Testez chaque modèle de page avec le test de compatibilité mobile de Google

- Vérifiez votre balise meta viewport :

<meta name="viewport" content="width=device-width, initial-scale=1"> - Confirmez que le texte est lisible sans zoom (taille de police minimale de 16 px pour le corps du texte)

- Assurez-vous que les cibles tactiles (boutons, liens) font au moins 48×48 pixels avec 8 px d’espacement

- Vérifiez qu’aucun contenu n’est plus large que l’écran (le défilement horizontal est un échec)

Parité de contenu

- Vérifiez que les pages mobiles contiennent le même contenu que les pages bureau

- Confirmez que toutes les données structurées existent dans la version mobile

- Vérifiez que les images, vidéos et textes alternatifs apparaissent sur mobile

- Assurez-vous que les balises de titre et les méta descriptions sont identiques dans toutes les versions

- Testez le contenu chargé en différé avec l’agent utilisateur Googlebot Smartphone

Vitesse mobile

- Testez la vitesse de page mobile séparément (les connexions mobiles sont plus lentes)

- Priorisez l’optimisation du LCP spécifiquement pour mobile

- Réduisez le poids total de la page à moins de 3 Mo sur mobile

- Évitez les grands bundles JavaScript qui bloquent le rendu mobile

- Compressez les images aux tailles appropriées pour mobile en utilisant les attributs

srcsetetsizes

Checklist de sécurité

HTTPS est un signal de positionnement confirmé par Google. Au-delà du positionnement, les navigateurs signalent les sites HTTP comme « Non sécurisé », ce qui détruit la confiance des utilisateurs et les taux de conversion.

Implémentation HTTPS

- Installez un certificat SSL/TLS valide sur tous les domaines et sous-domaines

- Redirigez toutes les URLs HTTP vers HTTPS avec des redirections 301

- Mettez à jour tous les liens internes pour utiliser

https://(pas de protocole relatif//) - Vérifiez l’absence d’avertissements de contenu mixte (ressources HTTP chargées sur des pages HTTPS)

- Définissez les en-têtes HSTS :

Strict-Transport-Security: max-age=31536000; includeSubDomains - Confirmez que votre certificat SSL n’est pas expiré ou mal configuré

En-têtes de sécurité

- Ajoutez des en-têtes

Content-Security-Policypour prévenir les attaques XSS - Implémentez

X-Content-Type-Options: nosniffpour prévenir le sniffing de type MIME - Définissez

X-Frame-Options: SAMEORIGINpour prévenir le clickjacking - Ajoutez

Referrer-Policy: strict-origin-when-cross-originpour le contrôle des données de référence - Activez

Permissions-Policypour contrôler l’accès aux fonctionnalités du navigateur

Protection contre les logiciels malveillants et le spam

- Surveillez le rapport « Problèmes de sécurité » de Google Search Console chaque semaine

- Scannez les spams ou logiciels malveillants injectés avec Sucuri SiteCheck ou des outils similaires

- Maintenez votre CMS, plugins et logiciels serveur à jour avec les dernières versions stables

- Examinez les zones de contenu généré par les utilisateurs (commentaires, forums) pour les liens de spam

- Configurez les alertes Google Safe Browsing pour votre domaine

Checklist de données structurées et schema

Les données structurées aident Google à comprendre le sens de votre contenu. Elles génèrent également des résultats enrichis comme des menus déroulants FAQ, des notes en étoiles, des étapes « comment faire » et des fils d’Ariane dans les résultats de recherche.

La documentation sur les données structurées de Google liste plus de 30 types de schema pris en charge.

Types de schema requis

Tous les types ne s’appliquent pas à tous les sites. Commencez par ceux-ci selon votre contenu :

| Type de schema | À utiliser pour | Résultat enrichi |

|---|---|---|

Article | Articles de blog et d’actualités | Titre + date dans les résultats |

FAQPage | Sections FAQ dans les pages | Q&R dépliables dans les résultats |

HowTo | Tutoriels étape par étape | Étapes numérotées dans les résultats |

LocalBusiness | Emplacements physiques | Panneau de connaissance, pack de cartes |

Organization | Informations sur l’entreprise | Logo + liens sociaux dans le panneau |

BreadcrumbList | Fils d’Ariane de navigation | Chemin de fil d’Ariane dans les résultats |

Product | Pages de produits e-commerce | Prix, disponibilité, notes |

Checklist d’implémentation

- Ajoutez le schema

Organizationà votre page d’accueil avec nom, logo, URL et profils sociaux - Implémentez le schema

ArticleouBlogPostingsur tout le contenu de blog - Ajoutez le schema

FAQPageaux pages avec des sections FAQ - Utilisez le schema

BreadcrumbListsur toutes les pages internes - Ajoutez le schema

LocalBusinesssi vous avez un emplacement physique - Incluez le balisage d’auteur et d’éditeur pour les signaux E-E-A-T

Lisez le guide complet dans notre guide de balisage schema.

Validation et tests

- Testez tout le schema avec l’outil de test des résultats enrichis de Google

- Validez la syntaxe JSON-LD avec le Validateur Schema.org

- Vérifiez la section « Améliorations » de Google Search Console pour les erreurs de schema

- Surveillez l’apparition des résultats enrichis dans le rapport Performance de Search Console

- Utilisez notre générateur de balisage schema gratuit pour créer rapidement du JSON-LD valide

Les données structurées génèrent des résultats enrichis qui augmentent les taux de clics de 20-30 %. Chaque article de blog que nous publions inclut un balisage schema complet. Commencer pour 1 $ →

Checklist de structure d’URL et de redirections

Des URLs propres aident les utilisateurs et les moteurs de recherche à comprendre votre contenu avant de cliquer. Une gestion correcte des redirections préserve le link equity et évite le gaspillage d’exploration.

Meilleures pratiques d’URL

- Utilisez des URLs en minuscules séparées par des tirets :

/checklist-seo-technique/et non/Checklist_SEO_Technique - Gardez les URLs courtes et descriptives (moins de 75 caractères si possible)

- Incluez votre mot-clé cible dans le slug de l’URL

- Évitez les paramètres d’URL pour les pages de contenu (

?id=123crée du contenu dupliqué) - Utilisez une convention de barre oblique finale cohérente sur tout le site (toujours ou jamais)

- Évitez les URLs basées sur des dates pour le contenu evergreen (

/2026/03/article/donne une impression de contenu dépassé)

Gestion des redirections

- Auditez toutes les redirections pour les chaînes (A redirige vers B qui redirige vers C) et corrigez-les pour aller de A à C

- Remplacez les redirections 302 (temporaires) par des redirections 301 pour les déplacements permanents

- Mettez à jour les liens internes pour pointer directement vers les URLs finales (ne vous fiez pas aux redirections)

- Configurez des redirections 301 pour toutes les pages supprimées ou déplacées vers la page la plus pertinente

- Surveillez les erreurs 404 dans Google Search Console et redirigez celles qui ont beaucoup de trafic

- Tenez à jour un document de carte de redirections à chaque changement de structure d’URL

Optimisation de la page 404

- Créez une page 404 personnalisée avec navigation, recherche et liens vers le contenu populaire

- Renvoyez un code de statut HTTP 404 approprié (pas un soft 404 qui renvoie 200)

- Explorez régulièrement votre site pour trouver et corriger les liens internes pointant vers des pages 404

- Vérifiez les erreurs 404 causées par des liens externes et redirigez-les si le contenu a été déplacé

Checklist de préparation aux robots d’exploration IA et LLM

En 2026, la recherche va au-delà de Google. Les moteurs de réponse IA comme ChatGPT Search, Perplexity et Google AI Overviews puisent dans les sites web pour générer des réponses. Votre robots.txt régit désormais l’accès pour les robots d’exploration traditionnels et IA.

Accès aux robots d’exploration IA

- Définissez votre politique envers les robots d’exploration IA : autoriser les bots d’entraînement, les bots de récupération, les deux, ou aucun

- Ajoutez des règles explicites pour

GPTBot,ClaudeBot,PerplexityBotetGoogle-Extendeddansrobots.txt - Autorisez les bots de récupération si vous voulez être visible dans les résultats de recherche IA

- Bloquez les bots d’entraînement si vous ne voulez pas que votre contenu soit utilisé pour l’entraînement de modèles

- Révisez votre politique trimestriellement à mesure que de nouveaux robots d’exploration IA émergent

Exemple de règles robots.txt :

## Autoriser la récupération pour la recherche IA

User-agent: GPTBot

Allow: /blog/

Disallow: /private/

## Bloquer l'entraînement

User-agent: Google-Extended

Disallow: /Lisez notre guide complet des robots d’exploration IA pour le détail de chaque bot.

Optimisation du contenu pour les LLM

- Créez un fichier

llms.txtà la racine de votre domaine avec un résumé structuré de votre site (voir notre guide llms.txt) - Structurez le contenu avec des titres clairs, des listes à puces et des réponses directes

- Incluez du contenu riche en entités avec des outils, marques et points de données spécifiques nommés

- Ajoutez des biographies d’auteurs et des signaux E-E-A-T que les systèmes IA utilisent pour évaluer l’autorité de la source

- Surveillez la visibilité dans les recherches IA avec des outils comme Otterly.ai ou des tests manuels dans ChatGPT et Perplexity

Apprenez à optimiser spécifiquement pour Google AI Overviews.

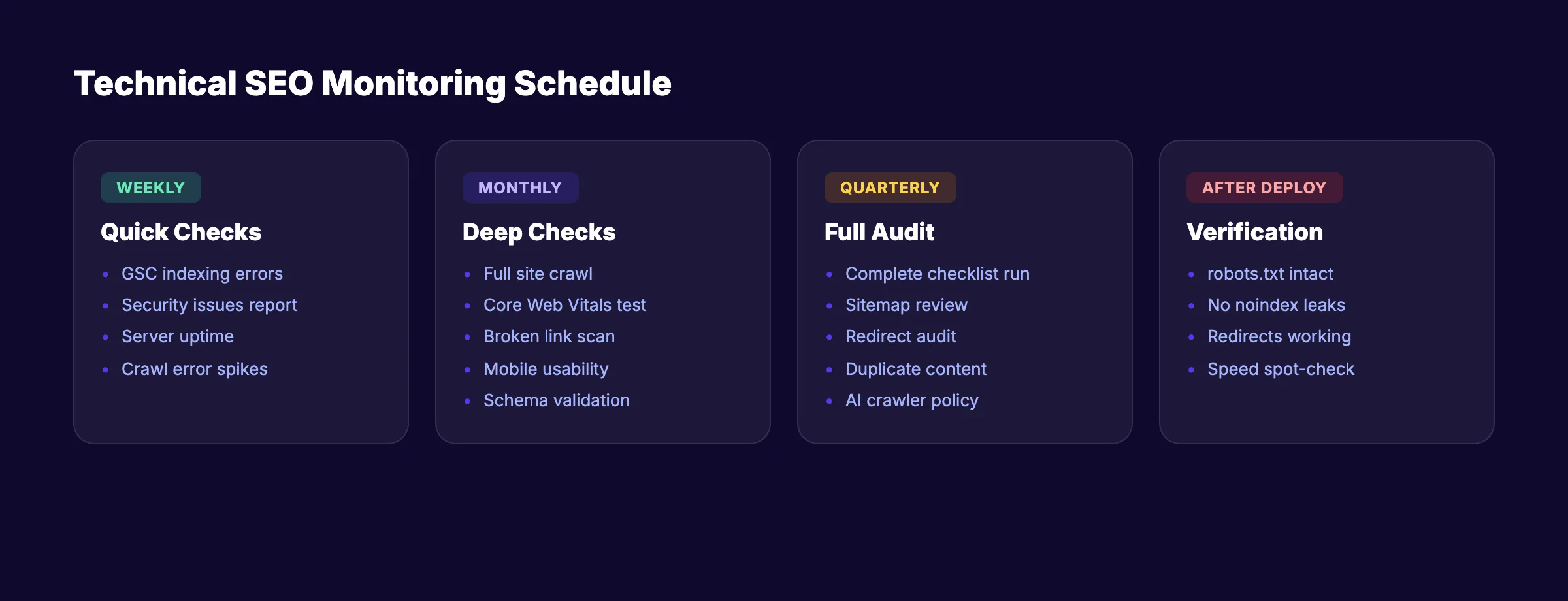

Checklist de surveillance et de maintenance

Le SEO technique n’est pas un projet ponctuel. Les sites se cassent silencieusement. Les mises à jour CMS introduisent des bugs. Les plugins ajoutent du lest. Les développeurs publient du code qui bloque l’indexation.

Mettez en place un système de surveillance récurrent pour détecter les problèmes avant qu’ils ne nuisent au positionnement.

Vérifications hebdomadaires

- Examinez le rapport « Pages » de Google Search Console pour les nouvelles erreurs d’indexation

- Vérifiez le rapport « Problèmes de sécurité » pour les alertes de logiciels malveillants ou de piratage

- Surveillez la disponibilité du serveur et le temps de réponse

- Examinez les pics d’erreurs d’exploration dans les statistiques d’exploration de Search Console

Vérifications mensuelles

- Effectuez une exploration complète du site avec Screaming Frog, Sitebulb ou notre outil d’audit gratuit

- Testez les Core Web Vitals sur vos 10 pages à plus fort trafic

- Vérifiez les nouveaux liens brisés sur tout le site

- Examinez le rapport d’utilisabilité mobile dans Google Search Console

- Auditez la validation du schema pour les pages nouvelles ou mises à jour

- Vérifiez votre score SEO du site web pour la santé globale

Vérifications trimestrielles

- Effectuez un audit complet en utilisant toute cette checklist SEO technique

- Révisez et mettez à jour votre sitemap XML (supprimez les pages mortes, ajoutez-en de nouvelles)

- Auditez les chaînes et boucles de redirections

- Vérifiez les nouveaux problèmes de contenu dupliqué

- Révisez les politiques de robots d’exploration IA et mettez à jour

robots.txtsi nécessaire - Analysez les données Google Analytics 4 pour les pages avec de nombreuses impressions mais peu de clics

Après chaque déploiement

- Vérifiez que

robots.txtn’a pas été écrasé par des règles de staging - Confirmez que les balises

noindexn’ont pas été publiées sur les pages de production - Testez que les redirections 301 fonctionnent toujours

- Effectuez une exploration rapide de 50 à 100 pages clés pour vérifier les erreurs

- Testez la vitesse de page sur 3 à 5 modèles clés

Outils recommandés

| Outil | Ce qu’il fait | Coût |

|---|---|---|

| Google Search Console | Couverture d’index, statistiques d’exploration, Core Web Vitals | Gratuit |

| Screaming Frog | Exploration complète du site jusqu’à 500 URLs | Gratuit (payant pour 500+) |

| PageSpeed Insights | Tests Core Web Vitals | Gratuit |

| Ahrefs Site Audit | Audit technique complet avec surveillance | Payant |

| Sitebulb | Analyse visuelle d’exploration | Payant |

| Stacc SEO Audit Tool | Vérification rapide de la santé du site | Gratuit |

Utilisez la Google Search Console comme votre outil de surveillance gratuit principal. Il détecte la plupart des problèmes techniques critiques et envoie des alertes par e-mail pour les problèmes graves.

Si vous souhaitez ignorer complètement le travail manuel, automatisez votre workflow SEO et laissez un système gérer la surveillance à votre place.

La maintenance du SEO technique est la différence entre se positionner et ne pas se positionner. Nous gérons la base technique de chaque site que nous publions. Commencer pour 1 $ →

FAQ

Qu’est-ce qu’une checklist SEO technique ?

Une checklist SEO technique est une liste structurée de tâches qui garantissent que les moteurs de recherche peuvent explorer, indexer, rendre et positionner votre site web correctement. Elle couvre la configuration du serveur, la vitesse du site, la sécurité, les données structurées, l’optimisation mobile et la gestion des URL. Considérez-la comme l’inspection des fondations avant de construire quoi que ce soit dessus.

À quelle fréquence dois-je effectuer un audit SEO technique ?

Effectuez un audit complet au moins une fois par trimestre. Les grands sites (10 000+ pages) ou les sites avec des mises à jour fréquentes devraient auditer mensuellement. Effectuez toujours la checklist après une refonte de site, une migration de CMS ou une mise à jour de plateforme. Consultez comment faire un audit SEO pour le processus complet.

Quels sont les problèmes SEO techniques les plus critiques à corriger en premier ?

Commencez par les bloqueurs d’indexation. Vérifiez les balises noindex accidentelles, les blocages robots.txt et les erreurs de canonical. Ceux-ci empêchent Google de voir vos pages. Ensuite, corrigez les liens brisés et les chaînes de redirections. Puis passez aux Core Web Vitals et à la vitesse du site. Vous pouvez utiliser les meilleurs outils SEO gratuits pour identifier rapidement les plus gros problèmes.

Le SEO technique affecte-t-il directement le positionnement ?

Oui. Google confirme que HTTPS, les Core Web Vitals et la compatibilité mobile sont des facteurs de positionnement. La crawlabilité et l’indexation sont des prérequis totaux pour le positionnement. Une page que Google ne peut pas explorer ou indexer a zéro chance d’apparaître dans les résultats de recherche. Les sites qui corrigent les problèmes techniques voient généralement des améliorations de positionnement en 60 à 90 jours.

Puis-je faire du SEO technique moi-même sans développeur ?

De nombreux éléments de cette checklist nécessitent des connaissances techniques de base mais pas des compétences de développement complètes. Vous pouvez auditer votre site avec des outils gratuits comme Google Search Console et Screaming Frog. Pour les modifications de la configuration du serveur, des fichiers .htaccess ou des en-têtes de réponse, vous aurez peut-être besoin d’un développeur. Si vous voulez que le SEO de votre nouveau site web soit géré sans équipe, les services tout-en-un éliminent la courbe d’apprentissage.

Quelle est la relation entre le SEO technique et le SEO on-page ?

Le SEO technique garantit que Google peut accéder et comprendre votre site. Le SEO on-page optimise le contenu des pages individuelles pour les mots-clés cibles. Les deux sont nécessaires. Le SEO technique est le fondement. Le SEO on-page est la structure construite dessus. Aucun ne fonctionne pleinement sans l’autre.

Commencez à travailler sur votre checklist

Chaque amélioration de positionnement commence par la bonne base technique. Imprimez cette checklist. Ouvrez Google Search Console. Parcourez une section par jour.

Si vous préférez sauter le travail manuel, nous gérons toute la partie technique et contenu du SEO pour les petites entreprises et les entreprises de services dans plus de 70 secteurs. Vos 3 premiers jours coûtent 1 $.

Rédigé par

Siddharth GangalSiddharth est le fondateur de theStacc et Arka360, diplômé de l'IIT Mandi. Il a passé des années à observer comment de bonnes entreprises perdaient du trafic organique face à des concurrents qui publiaient simplement plus. Il a donc construit un système pour y remédier.